Ryota Tanaka

@rtanaka_lab

NLP, Vision&Language @ NTT Human Informatics Laboratories

ID: 998127492467576832

https://rtanaka-lab.github.io/ 20-05-2018 09:05:13

486 Tweet

901 Followers

509 Following

#NLP2025 では、主著1本、共著2本の発表があります。 主著は、LLMのファインチューニング段階におけるPadding戦略とPacking戦略の下流タスクに対する影響を調査した話です。 現地参加の方は、 ・03/11 14:50-16:20 1F Q4(ポスター)会場 にぜひお越しください! お待ちしてます! Tohoku NLP Group

#AI王 の論文(共著)が、今年度の言語処理学会最優秀論文賞を受賞しました! 🙌 論文を選考くださった方々、「AI王」に関わってくださったすべての皆さまに、心より感謝いたします。 Tohoku NLP Group AI王〜クイズAI日本一決定戦〜

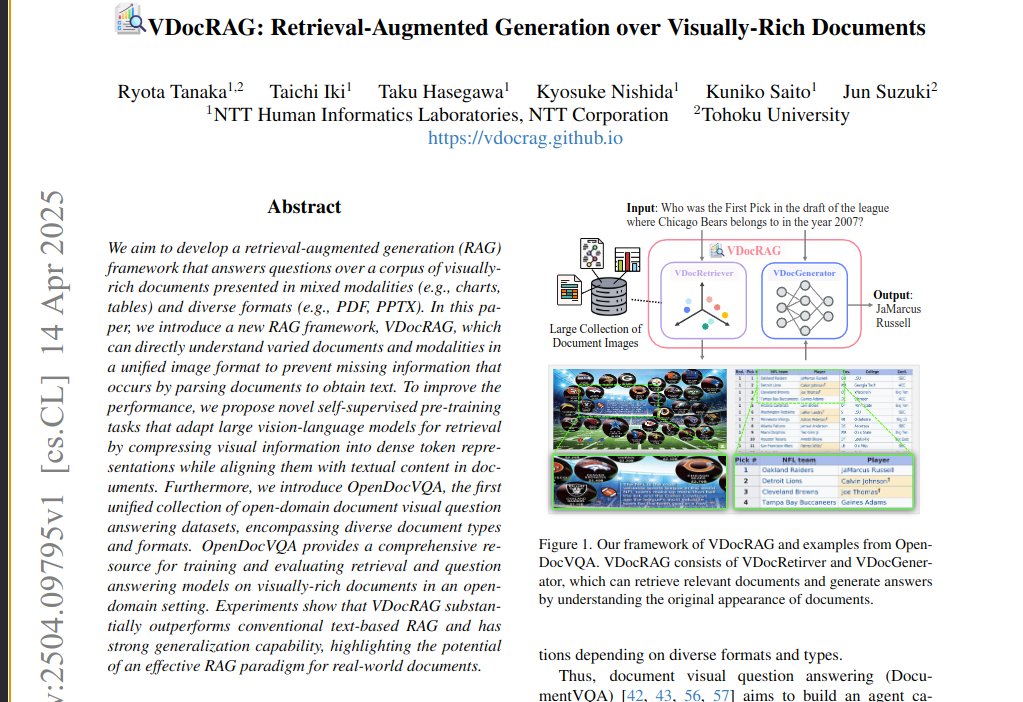

VDocRAG: Retrieval-Augmented Generation over Visually-Rich Documents Ryota Tanaka et al. introduce a RAG framework that directly understands diverse document formats through visual features. 📝arxiv.org/abs/2504.09795 👨🏽💻vdocrag.github.io

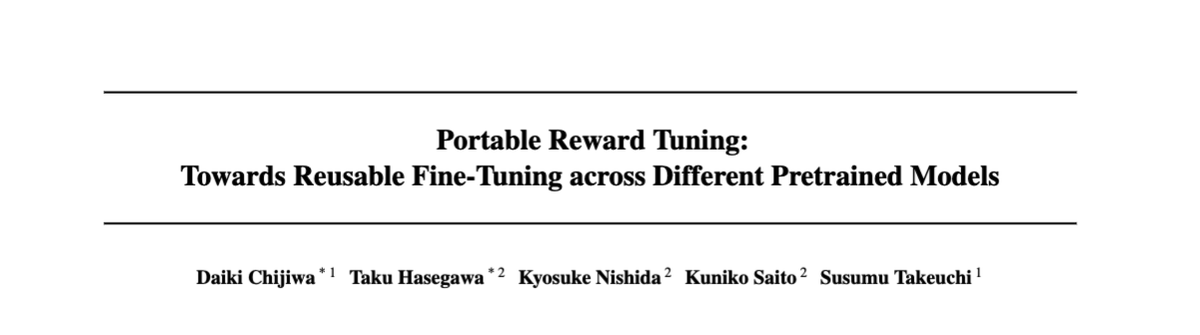

🎉 Excited to announce our ICML 2025 paper “Portable Reward Tuning: Towards Reusable Fine‑Tuning across Different Pretrained Models,” co‑first‑authored with Daiki Chijiwa 🤝(equal contribution)! #ICML2025 Preprint 👉 arxiv.org/abs/2502.12776

This is also an awesome work by Ryota Tanaka Ryota Tanaka , enabling visually document processing by RAG with related textual images! Come NOW to #363 at #CVPR2025 poster session!